企业落地 AI Skill 的 12 个疑问

返回博客列表

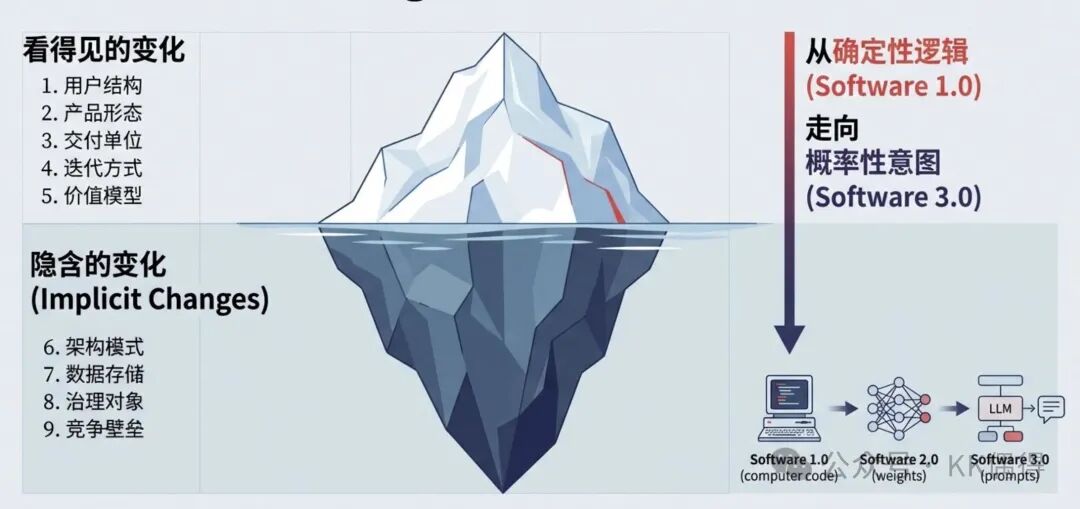

企业落地 AI,常见路径是 Prompt → RAG → AI 应用,复杂度依次递增。Prompt 灵活但不稳定,RAG 能接入知识库但工程量大,AI 应用功能完整但开发周期长、维护成本高。Skill 提供了一种介于 Prompt 和 AI 应用之间的务实选择:把反复出现的任务流程写成结构化文件,让 AI 按统一标准执行。它不依赖硬编码,是企业落地 AI 的一条轻量路径。

目前,企业内 Skill 落地仍在探索阶段。本文整理了实践中 12 个典型疑问及当前应对思路,供参考。

- Skill 是什么?

- Q1: Skill 到底是什么?和 Prompt、MCP、AI 应用有什么区别和联系?

- Q2: 企业内部哪些场景适合用 Skill?

- Skill 怎么建?

- Q3: 不用 Claude,用其他模型落地效果差多少?怎么补救?

- Q4: Skill 该让业务专家写,还是技术人员写?

- Q5: Skill 文件存哪儿?需要像代码一样管版本吗?

- Q6: 多语言/跨国团队,Skill 要分语言建吗?

- Q7: Skill 需要测试吗?怎么测?

- Skill 怎么用?

- Q8: Skill建好了怎么让用户发现并愿意用?

- Q9: Skill 多了会不会识别错乱?怎么解决?

- Skill 怎么管?

- Q10:Skill 需要监控和错题本吗?怎么持续优化?

- Q11:Skill 可能改数据,怎么管权限保安全?

- Q12:怎么避免 Skill 三个月热度,确保投资收益?

Part 1:是什么

❓ 1:Skill 到底是什么?和 Prompt、MCP、AI 应用有什么区别和联系?

Skill是什么

Anthropic Skill 是可复用的结构化指令集,采用“渐进式披露”架构,Claude 先只加载各个 Skill 的元数据(名称、描述等关键字段),等用户的任务意图匹配时,才拉取完整内容。这种设计让 Skill 成了嵌在对话流中的“智能顾问”,能自动发现并应用背景知识,在不超出上下文限制的情况下,输出更符合用户意图的结果。

从结构上看,Skill 不是“更长的 Prompt”或 Prompt 模板,而是一个完备的能力单元。一个标准的 Skill 通常包含:

- 任务边界:解决什么问题、不处理什么情况

- 输入/输出契约:参数、格式、结构约定

- 执行指令:任务步骤和判断条件

- 知识上下文:领域术语、规则文档、示例

- 工具调用:检索、表格处理、外部 API(可选)

- 校验机制:格式检查、规则核对

- 版本管理:CHANGELOG + 语义化版本号(参见疑问 5)

所以,Skill 的核心不是提示词技巧,而是把经验固化成可调用、可迭代、可治理的能力模块。

Skill vs. Prompt vs. MCP vs. AI应用

| 概念 | 本质 | 存在形式 | 核心作用 |

|---|---|---|---|

| Prompt | 单次指令 | 自然语言文本 | 告诉 AI"这次做什么" |

| Skill | 可复用的结构化知识包 | SKILL.md 文件 + 可选脚本 | 告诉 AI"这类事怎么做",在支持的平台上 AI 可自动判断何时调用 |

| MCP | 连接外部系统的标准协议 | 协议规范 + Server/Client 实现 | 让 AI 能查到外部数据、能操作外部系统 |

| AI 应用 / Agent | 完整软件系统(含任务编排层) | 前后端 + 数据库 + 模型编排 | 把 AI 嵌入业务流程,其中 Agent 负责任务编排与调度,支持审计和管控 |

Prompt 用一次写一次;Skill 写一次可反复用,在 Claude 等原生支持的平台上,AI 能自动判断是否调用(其他模型需要自建路由);MCP 不管业务逻辑,只负责连接外部系统;AI 应用是完整的工程方案,Agent 是其中专门负责任务编排的能力层,本文不做区分。

Skill 与 Prompt, MCP,AI 应用之间的联系

用户说:"分析一下客户 12345 的健康度,如果风险高就创建跟进工单"

│

▼

[调度层] 识别意图,匹配"客户健康度分析"Skill

│

├─→ 步骤 1:调取客户数据 ──→ [MCP] 查询 CRM 系统

│

├─→ 步骤 2:分析评分 ────→ [Skill] 按内置规则计算

│

├─→ 步骤 3:判断风险 ────→ [Skill] 评分<60 且 工单>2 则高风险

│

└─→ 步骤 4:创建工单 ────→ [MCP] 调用 Jira API

│

▼

[AI 应用] 在飞书/自建系统展示结果

│

▼

遇到流程未覆盖的异常情况

│

▼

[Prompt] 人工介入处理

案例 1:企业简历批量筛选与初评

某企业 HR 每天需要处理上百份格式各异的简历,流程涉及从招聘系统获取简历、解析内容、根据岗位要求评估匹配度、生成初评意见并录入系统。如果用 Agent + Skill + MCP 的方式拆解:

| 环节 | 负责方 | 具体动作 |

|---|---|---|

| 任务统筹 | Agent | 将"处理新投递简历"拆解为读取、解析、评估、回填等有序步骤 |

| 简历获取 | MCP | 对接内部 ATS 或招聘平台,批量获取新投递的候选人简历 |

| 内容解析与评估 | Skill + LLM | "简历解析 Skill"统一提取关键经历;"岗位匹配度评估 Skill"提供用人标准和打分规则,LLM 完成综合评定 |

| 结果回填与跟进 | Skill + MCP | "候选人触达 Skill"生成模板化话术,MCP 对接系统更新候选人状态并发送邮件 |

案例 2:企业合同法务预审流程

业务线提交商务合同后,法务需要核对付款条款、违约责任等,确保符合公司底线。使用协同架构的拆解方式:

| 环节 | 负责方 | 具体动作 |

|---|---|---|

| 任务调度 | Agent | 接收合同审查请求,识别合同类型(采购/销售/保密等),规划审查顺序 |

| 外部尽调查询 | MCP | 调取企业信用查询系统,核验合同相对方的工商状态和涉诉风险 |

| 规则匹配与预审 | Skill + LLM | "合同审查 Skill"提供公司的标准账期、违约金上限等判定规则,LLM 找出不合规处 |

| 报告生成与流转 | Skill + MCP | "审查报告 Skill"提供报告结构和措辞规范,MCP 对接 OA 系统将修改建议推回给业务侧 |

小结:在分工上,Agent 决定做什么、按什么顺序做;Skill 提供环节执行方法和质量标准;MCP 负责连接外部系统,完成数据读写。在没有完整 Agent 能力的场景下,Skill 和 MCP 仍可单独或组合使用,由人工代替 Agent 统筹调度。

❓ 2:企业内部哪些场景适合用 Skill?

Skill 适用的场景条件

- 每周出现 3 次以上

- 有明确的SoP、判断标准和输出格式,不能靠"感觉"

- 多人要做同样的事,目前大家做得参差不齐

- 出错成本可控,人工能复核,不涉及资金或合规红线

- 不强依赖外部系统实时数据,需实时数据的场景通常要配合 MCP

Skill, Prompt, MCP和 AI应用的各自适用场景

| 场景特征 | Prompt | Skill | MCP | AI 应用 |

|---|---|---|---|---|

| 探索性任务 例:市场趋势脑暴、产品命名 | ✅ 灵活发散,适合试错 | ❌ 限制过多 | ❌ 无需外部数据 | ❌ 太重 |

| 一次性任务 例:临时格式转换、特定邮件 | ✅ 成本低 | ❌ 建 Skill 比直接问还麻烦 | ❌ 无需系统连接 | ❌ 不值当 |

| 高频重复知识工作 例:财务月报、SEO 检查 | ❌ 每次写 Prompt 不一致 | ✅ 标准化输出 | ❌ 无实时数据需求 | ❌ 过度设计 |

| 需实时数据的分析 例:查库存、查客户 360 | ❌ 拿不到实时数据 | ⚠️ 单独用不行,需配合 MCP | ✅ 查 ERP/CRM 实时数据 | ✅ 集成展示 |

| 触发系统操作 例:创建工单、更新状态 | ❌ 无权限 | ⚠️ 需配合 MCP | ✅ 调用 API | ✅ 自动完成流程 |

| 高风险决策 例:金融审批、医疗诊断 | ❌ 无审计 | ❌ 无完整审计链路 | ❌ 仅连接,无风控 | ✅ 审计、人工节点、版本回滚 |

| 嵌入现有系统 例:飞书审批、ERP 插件 | ❌ 只能在对话框用 | ❌ 无界面能力 | ❌ 仅数据层 | ✅ 完整前端集成 |

说明:表格中的标记指单独使用时的适用性。实际场景中 Skill + MCP 组合使用是常见模式,比如用 Skill 定义分析流程,用 MCP 拉取实时数据。

Part 2:怎么建

❓ 3:不用 Claude,用其他模型落地效果差多少?怎么补救?

能力差异对比

| 能力 | Claude 原生 Skills | 其他模型(Kimi/Qwen/DeepSeek 等) |

|---|---|---|

| 自动识别 | 原生支持,通过 Skill 的核心描述字段自动匹配意图 | 需自建路由(我们实测准确率约 85%,17 个 Skill,100 条测试) |

| Token 消耗 | 按需注入当前调用的 Skill 内容,而非全部 Skill;结合 Anthropic 的 Prompt Caching 可进一步降低重复前缀的 token 成本 | 通常需全量加载 Prompt,暂无按需注入机制 |

| 脚本执行 | 内置沙箱 | 需自建或接入如 Docker、E2B 等代码执行沙箱 |

| 输出稳定性 | 结构化约束较强 | 依赖 Prompt 工程,容易漂移 |

补救思路:自建 Skill 路由

# 简化版 Skill 路由的工作流程描述(面向非技术人员)

路由注册表:

可用服务清单:

- 财务报告

- 客户健康度分析

# ... 系统中登记的核心场景,类似于派单专员手里的“业务黄页”

路由作业流程:

步骤1_服务发现与匹配:

输入: 用户的自然语言请求

匹配动作:

- 【方案 A】外接一个小巧便宜的 AI 模型专门负责意图打标签和分类

- 【方案 B】提取请求关键词,去“可用服务清单”中做相似度匹配(当前实测性价比最高)

输出: 智能锁定最对口的“目标 Skill”

步骤2_工作指令组装:

读取: 从系统中偷偷抽出该目标 Skill 身后的“专业处方模板”

拼接: 将“专业处方”和“用户刚才的具体提问”揉合拼接在一起

输出: 生成一段精确、充实、不缺漏上下文数据的系统指令

步骤3_模型推演与沙箱保护:

生成答复: 将上述组装好的饱满指令正式发送给主力大模型(如 Kimi、DeepSeek 等)去干活

安全沙箱: (可选兜底保障)如果返回的答复中带有需要运行的数据处理代码,绝不能直接跑。

系统必须将其扔进完全隔离的“安全沙箱”环境中试运行,切断搞坏系统的可能。

交付落库: 最终将干净、加工好的分析结论呈现给终端用户

取舍提示:

- 不追求与 Claude 完全一致,先保障核心 Skill 的识别准确率

- Skill 总量控制在 20 个以内,降低路由复杂度

- Prompt 与业务逻辑解耦,后续如果切换模型,迁移成本可控

❓ 4:Skill 该让业务专家写,还是技术人员写?

我们试过三种模式,目前用的是第三种:

| 模式 | 做法 | 结果 | 原因 |

|---|---|---|---|

| 业务自建 | 培训业务人员按模板写 | 8 个里 6 个不能用 | 步骤描述太泛或跳跃,缺少 AI 执行所需的判断条件和输出格式约束 |

| 技术代建 | 技术人员访谈后代写 | 功能能跑但业务不爱用 | 缺少业务侧的隐性知识,比如"这个异常要人工判""数字要四舍五入" |

| 双人配合 (当前采用) | 业务讲流程,技术写实现,共同测试 | 可用且业务愿意用 | 各出擅长的部分 |

双人配合的具体分工:

| 阶段 | 业务负责 | 技术负责 | 耗时 |

|---|---|---|---|

| 需求澄清 | 口述现状、步骤、判断标准 | 倾听,追问细节 | 2h |

| 流程固化 | 确认流程图 | 画流程图,写检查清单 | 4h |

| Skill 编写 | 审阅 | 写 SKILL.md,设计关键词 | 4h |

| 测试调优 | 用真实案例跑 10 轮,标记偏差 | 修复,调描述 | 8h |

| 上线运营 | 推广,收集反馈 | 监控,迭代 | 持续 |

建议每个部门培养 1-2 名"AI 翻译官":既懂业务流程,又理解 AI 的能力边界,负责筛选需求和质量把关。

❓ 5:Skill 文件存哪儿?需要像代码一样管版本吗?

存储位置:Git 仓库,和普通代码同级管理。

目录结构:

skills-repo/

├── 财务/

│ ├── 月度报告/

│ │ ├── SKILL.md # 当前版本(只读)

│ │ ├── CHANGELOG.md # 变更记录:改了什么、为什么改

│ │ ├── test-cases/ # 黄金测试用例

│ │ │ ├── case_001.yaml

│ │ │ └── case_002.yaml

│ │ └── versions/ # 历史版本归档

│ │ ├── v1.0.0_20250115.md

│ │ ├── v1.1.0_20250320.md

│ │ └── v2.0.0_20250610.md # 格式变更,影响下游解析

│ └── 预算审查/

├── 销售/

│ └── 客户健康度/

└── 研发/

└── 代码安全审查/

版本规则:

| 变更类型 | 版本号变化 | 审批要求 | 通知范围 |

|---|---|---|---|

| 改描述、加例子 | v1.1.0 → v1.1.1 | 技术审 | 无 |

| 改步骤、换判断标准 | v1.1.0 → v1.2.0 | 业务+技术双审 | 使用该 Skill 的团队成员 |

| 改输出格式、影响下游解析 | v1.2.0 → v2.0.0 | 三审(加合规) | 全量用户+下游系统负责人 |

我们踩过一个坑:更新了财务 Skill 的输出格式但没通知下游,导致依赖该格式的 Python 解析脚本报错,影响了月度关账。之后强制要求:输出格式变更必须走大版本升级,提前 3 天通告。

❓ 6:多语言/跨国团队,Skill 要分语言建吗?

我们的做法:核心英文 + 区域变体

核心 Skill(英文,逻辑层)

│

├── 中文变体(描述、示例本地化)

│ └── 关键词双语:"客户健康度分析 / Customer Health Analysis"

│

├── 日文变体

│ └── 遵守当地个保法等数据合规要求

│

└── 德文变体

└── GDPR 数据脱敏规则集成

分两层管理:

- 通用层:跨地区一致的流程,如数据分析算法与计算逻辑

- 区域层:本地化合规要求和术语差异,如国内个保法与欧盟 GDPR 间的脱敏规定

技术团队用英文编写 Skill 保障底层逻辑一致,业务团队用本地语言交互。只保留关键描述字段为英文以方便模型识别。

❓ 7:Skill 需要测试吗?怎么测?

分阶段测试:

| 阶段 | 方式 | 通过标准 | 投入 |

|---|---|---|---|

| MVP | 人工跑 10-20 个典型案例 | 业务认可输出质量 | 2-3 人天 |

| 推广前 | 建立黄金测试集(50-100 例),半自动验证 | 准确率 >85%,格式 100% 合规 | 1-2 人周 |

| 成熟后 | 自动化测试:输入 → Skill → 输出 → 自动比对 | 失败率 <5%,定期自动跑 | 持续 |

黄金测试集示例(YAML 格式):

# test-cases/case_001_high_risk.yaml

id: 001

desc: "高活跃但高投诉客户应标中风险"

input:

customer_id: "12345"

login_count: 25

ticket_count: 4

ticket_sentiment: "negative"

expected:

health_score: 65

risk_level: "中"

action: "本周内主动触达,了解投诉详情"

must_contain: ["投诉", "主动触达", "65"]

must_not_contain: ["健康", "无需关注", "低风险"]

# test-cases/case_002_error_handling.yaml

id: 002

desc: "客户 ID 不存在时应报错提示"

input:

customer_id: "99999"

error_simulation: true

expected:

behavior: "error_graceful"

output_should: "提示检查 ID"

output_should_not: "崩溃/空指针/乱码"

自动化测试脚本:

# 简化版自动化测试工作流描述(面向非技术人员)

自动化测试流水线:

执行频率: 每天凌晨自动对核心 Skill 测一遍,新版本发布前必须测一遍

流水线作业步骤:

步骤1_发送考题:

动作: 批量调取当前 Skill 的“黄金测试集”(比如 100 道极端、易错的考题)

执行: 逐一扔给 AI 去处理,不带任何人工干预

步骤2_机器阅卷:

格式体检: 检查 AI 交上来的卷子是不是标准的格式(例如必须是结构化的 JSON)

得分点扫描: 核验答卷里是否必须包含了“指定关键词”(比如高风险等级的触发词)

踩雷点排查: 核验答卷里绝对不能出现“违禁词”(比如明明有投诉,却不准出现“健康”)

步骤3_巡检报告与飞书报警:

评估: 汇总最终的批改成绩,计算总体不合格率

处罚: 如果 100 道题里有超过 5 道答错(即错误率 > 5%)

通知: 立马拉响警报,并在群里强行 "@该 Skill 的业务和技术负责人" 要求去修错题

补充说明:关键词断言适合格式和关键信息的检查,但对于主观性较强的输出(比如分析报告的行文质量),可以考虑用另一个模型做主观评判,按预设的评分标准打分。这部分我们还在试验中。

Part 3:怎么用

❓ 8:建好了怎么让用户发现并愿意用?

可通过三个层面引导:

1. 发现层:主动推送,不依赖用户搜索

- 按角色推:财务登录飞书,首页工作台直接展示财务相关的 Skill

- 按场景推:检测到用户上传 Excel,提示"是否用【数据分析 Skill】?"

- 按热度推:展示"同部门同事本周在用"(不显示具体内容)

2. 使用层:上手门槛尽量低

用户输入:"分析一下这个月的销售数据"

│

▼

系统提示:"将使用【销售数据分析 Skill】,包含:趋势分析、环比、异常检测"

│

├─→ 用户确认:执行

└─→ 用户切换:展示其他可选 Skill 或转人工

│

▼

输出结果(附分析依据的说明)

3. 引导层:在使用中学习

- 首次使用时,侧边栏展示 Skill 能做什么与不能做什么的能力边界

- 提供"示例输入"一键填充,降低启动门槛

- 输出旁标注分析依据,如"因工单情绪为负面,风险等级上调"

❓ 9:Skill 多了会不会识别错乱?怎么解决?

遇到的问题:Skill 从 5 个增到 20 个后,开始出现错配,比如该调"客户健康度分析"却调出了"客户画像生成"。

五个应对办法:

| 办法 | 具体做法 | 效果 |

|---|---|---|

| 合并相似 Skill | 把"客户画像"和"客户标签"合并为"客户 360 分析" | 从 20 个减到 17 个,错配率下降 |

| 优化描述字段 | 不用"帮助分析客户",改为"客户健康度分析:汇总登录频次、工单数量与情绪、合同到期时间,输出健康评分和建议动作" | 匹配更准确 |

| 分层路由 | 先按财务、销售等用户角色缩小范围,再按关键词匹配 | 减少跨领域误匹配 |

| 引入“宏 Skill”编排 | (新增) 面对复杂请求时,不直接暴露所有底层能力。而是构建一个“总控调度 Skill”(宏 Skill),它只负责理解复杂意图,然后再自动分发和串联多个底层的“微 Skill”去干活 | 像“包工头”一样把任务拆解分发,有效避免了扁平式匹配带来的上下文爆炸和能力相互打架的乱象 |

| 支持手动指定 | 支持 @财务报告 或快捷指令 /finance-report | 自动识别不准时可人工兜底 |

描述字段优化前后对比:

# 优化前

description: "帮助财务同事生成报告"

# 优化后

description: "财务月度管理报告:读取 Excel 经营数据,计算环比/同比,识别异常科目,输出 Markdown 格式报告,包含数据血缘说明"

Part 4:怎么管

❓ 10:Skill 需要监控和错题本吗?怎么持续优化?

建议监控的几个指标:

| 指标 | 计算方式 | 参考基线 | 低于基线时的处理 |

|---|---|---|---|

| 触发准确率 | 自动匹配正确次数 / 总触发次数(用户未纠正视为正确) | >85% | 优化描述字段或合并相似 Skill |

| 输出满意度 | 👍/👎 反馈比例 | >80% 👍 | 分析差评案例,更新 Skill 内容 |

| 执行成功率 | 脚本报错率、格式解析失败率 | >95% | 修复脚本或放宽格式约束 |

| 时间节省 | 对比使用 Skill 前后的耗时 | 省 >50% | 低于预期则重新梳理流程 |

| 人工干预率 | 输出后需要大幅修改的比例 | <20% | 增加步骤细节或补充示例 |

上述基线是我们根据自身情况设定的参考值,各团队可按实际调整。

错题本模板(Markdown 格式):

## 错题记录 2025-06-15

**Skill**: 客户健康度分析 v1.2.1

**发现人**: 王五(客户成功经理)

**问题描述**:

客户近 7 天登录 0 次,但支持工单激增 5 个且情绪负面。

Skill 标记为"健康",没有提示风险,后来客户流失了。

**根因分析**:

评分算法只考虑了"使用活跃度",没有纳入"工单情绪"维度。

**修复方案**:

v1.3.2 增加工单情感分析步骤,负面工单 >2 个且情绪为负时,风险等级强制上调一级。

**验证结果**:

用 10 个历史流失案例复测,准确率从 70% 提升到 92%。

**负责人**: 张三(业务)+ 李四(技术)

**修复期限**: 3 个工作日内

优化节奏:每月一次 Skill 评审会,过一遍错题本,决定修复、合并或淘汰。

❓ 11:Skill 涉及数据操作,怎么管权限和安全?

五类风险和对应措施:

| 风险场景 | 防护措施 |

|---|---|

| 密钥硬编码 | 统一用环境变量或 AWS Secrets Manager 等密钥管理服务,Skill 内只写 {{API_KEY}},禁止写死 |

| 核心算法泄露 | 定价策略、风控规则等放后端 API,Skill 只调接口,不暴露计算逻辑 |

| 越权访问 | 与现有 SSO 打通,按角色控制可见性,例如财务 Skill 仅财务角色可见 |

| 敏感数据外泄 | Skill 内置脱敏规则:正则匹配手机号 \d{11}、身份证 \d{17}[\dX],输出时替换为 **** |

| 操作无审计 | 全链路日志:谁、何时、用哪个 Skill、输入了什么、输出了什么,保留 180 天 |

Skill 默认只读。如果涉及诸如创建工单、更新 CRM 等写操作,需要满足三个条件:

- 用户显式确认

- 高风险场景加人工复核节点

- 完整的操作日志

❓ 12:怎么避免 Skill 用了三个月就没人用?

Skill 推广失败通常不是因为 Skill 本身写得不好,而是没有解决使用动力的问题。常见原因:旧习惯更顺手、没有人要求必须用、出了问题没人维护、效果好坏也没人知道。

常见轨迹

- 第 1 个月:兴奋,全员使用 Skills,效率提升明显

- 第 3 个月:新鲜感消退,部分人回归老方法

- 第 6 个月:Skills 无人维护,逐渐废弃

长效运营机制

| 机制 | 具体做法 |

|---|---|

| 强制嵌入流程 | 关键交付物必须通过 Skill 生成初稿,否则无法进入下一环节 |

| 度量透明化 | 团队周报展示 "本周节省 XX 小时",与个人绩效弱挂钩 |

| 技能竞赛 | 季度评选 "最佳 Skill",奖励创作者,形成内部市场 |

| 新人入职必学 | 将核心 Skills 使用纳入 onboarding,不写进文档直接教 |

| 定期大扫除 | 每季度淘汰低频 Skill,合并重复 Skill,保持生态健康 |

写在最后

基础模型的能力日新月异,复杂的 AI 应用工程化成本很高,Skill 提供了一种轻量的 AI落地方式。Skill 更为核心价值在于:把组织中个人零散的 AI 使用经验,转化成组织集体可复用的“数字知识资产”。无论基础模型能力如何发展,这些“数字知识资产”都能持续发挥作用,不会随着基础模型升级而失效。

不知大家在落地 Skill 的实践中遇到了哪些疑问呢?有没有不一样的心得呢?欢迎在评论区留言交流。